Tətbiqi süni intellektdə diqqətin mərkəzində bir neçə il prompt mühəndisliyi olduqdan sonra, yeni bir termin ön plana çıxdı: kontekst mühəndisliyi. Dil modelləri ilə qurmaq artıq promptlarınız üçün düzgün söz və ifadələr tapmaqdan daha az, "modelin arzu olunan davranışını yaratmaq üçün ən çox ehtimal olunan kontekst konfiqurasiyası hansıdır?" kimi daha geniş suala cavab tapmaqla bağlıdır.

Kontekst böyük dil modelindən (LLM) nümunə götürərkən daxil edilən tokenlərin məcmusuna aiddir. Həll edilməli olan mühəndislik problemi isə arzu olunan nəticəni ardıcıl şəkildə əldə etmək üçün həmin tokenlərin faydalılığını LLM-lərin xas məhdudiyyətlərinə qarşı optimallaşdırmaqdır. LLM-ləri effektiv idarə etmək çox vaxt kontekst çərçivəsində düşünməyi tələb edir — başqa sözlə: istənilən vaxt LLM-ə əlçatan olan holistik vəziyyəti və bu vəziyyətin hansı potensial davranışlara gətirib çıxara biləcəyini nəzərə almaq.

Bu yazıda kontekst mühəndisliyinin inkişaf edən sənətini araşdıracaq və idarə olunan, effektiv agentlər qurmaq üçün təkmilləşdirilmiş zehni model təklif edəcəyik.

Kontekst mühəndisliyi və prompt mühəndisliyi

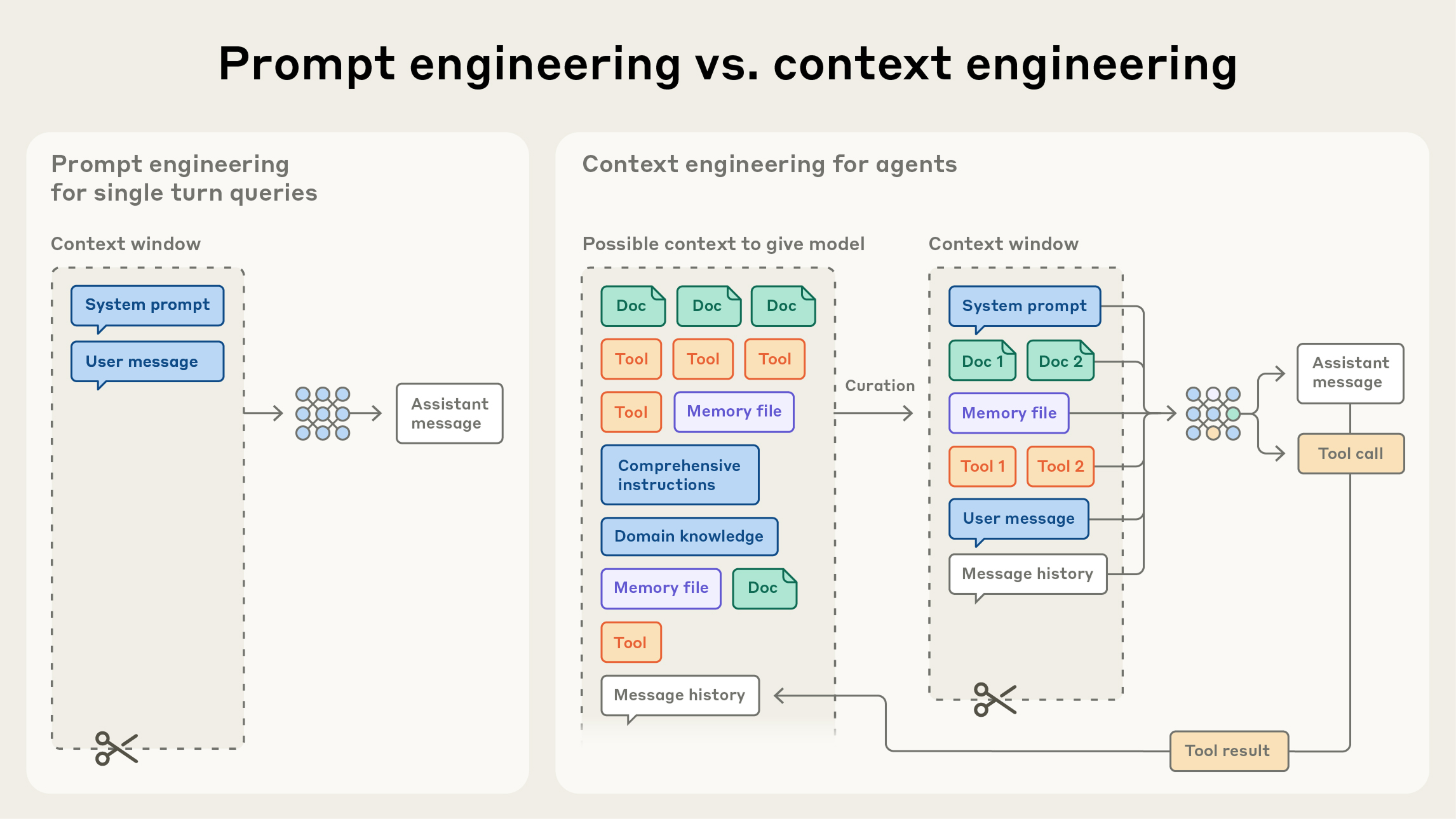

Anthropic-də biz kontekst mühəndisliyini prompt mühəndisliyinin təbii davamı kimi qəbul edirik. Prompt mühəndisliyi optimal nəticələr üçün LLM təlimatlarının yazılması və təşkili üsullarına aiddir (icmal və faydalı prompt mühəndisliyi strategiyaları üçün sənədlərimizə baxın). Kontekst mühəndisliyi isə LLM inferensiyası zamanı optimal token (informasiya) dəstinin seçilməsi və saxlanması strategiyalarının məcmusuna aiddir, o cümlədən promptlardan kənarda ora düşə biləcək bütün digər informasiya da buna daxildir.

LLM-lərlə mühəndisliyin ilk günlərində, gündəlik söhbət əlaqələrindən kənar istifadə hallarının əksəriyyəti bir dəfəlik təsnifat və ya mətn yaratma tapşırıqları üçün optimallaşdırılmış promptlar tələb etdiyi üçün, prompting süni intellekt mühəndisliyi işinin ən böyük komponenti idi. Terminin özünün ifadə etdiyi kimi, prompt mühəndisliyinin əsas diqqət mərkəzi effektiv promptların, xüsusən sistem promptlarının necə yazılmasıdır. Lakin biz çoxlu inferensiya dövrəsi və daha uzun zaman üfüqləri üzərində işləyən daha güclü agentlər qurmağa doğru irəlilədikcə, bütün kontekst vəziyyətini (sistem təlimatları, alətlər, Model Context Protocol (MCP), xarici məlumatlar, mesaj tarixçəsi və s.) idarə etmək üçün strategiyalara ehtiyacımız var.

Döngüdə işləyən agent inferensiyanın növbəti dövrəsi üçün əlaqəli ola biləcək getdikcə daha çox məlumat yaradır və bu informasiya tsiklik olaraq təmizlənməlidir. Kontekst mühəndisliyi daim inkişaf edən mümkün informasiya kainatından məhdud kontekst pəncərəsinə nəyin daxil ediləcəyini seçməyin sənəti və elmidir.

Prompt yazmaq kimi diskret tapşırıqdan fərqli olaraq, kontekst mühəndisliyi iterativdir və seçim mərhələsi hər dəfə modelə nə ötürəcəyimizə qərar verdikdə baş verir.

Prompt yazmaq kimi diskret tapşırıqdan fərqli olaraq, kontekst mühəndisliyi iterativdir və seçim mərhələsi hər dəfə modelə nə ötürəcəyimizə qərar verdikdə baş verir.

Kontekst mühəndisliyinin güclü agentlər qurmaq üçün əhəmiyyəti

Sürətlərinə və getdikcə daha böyük həcmli məlumatları idarə etmək qabiliyyətlərinə baxmayaraq, müşahidə etdik ki, LLM-lər, insanlar kimi, müəyyən bir nöqtədə diqqətlərini itirirlər və ya çaşqınlıq yaşayırlar. Needle-in-a-haystack tipli benchmarking üzrə araşdırmalar kontekst çürüməsi konsepsiyasını üzə çıxarıb: kontekst pəncərəsindəki tokenlərin sayı artdıqca, modelin həmin kontekstdən informasiyanı dəqiq xatırlama qabiliyyəti azalır.

Bəzi modellər digərlərinə nisbətən daha yumşaq deqradasiya nümayiş etsə də, bu xüsusiyyət bütün modellərdə özünü göstərir. Buna görə kontekst azalan marjinal gəlirlərə malik sonlu resurs kimi qəbul edilməlidir. Məhdud işçi yaddaş tutumuna malik insanlar kimi, LLM-lərin də böyük həcmli konteksti təhlil edərkən istifadə etdikləri "diqqət büdcəsi" var. Daxil edilən hər yeni token bu büdcəni müəyyən qədər azaldır və LLM-ə əlçatan tokenlərin diqqətlə seçilməsi ehtiyacını artırır.

Bu diqqət qıtlığı LLM-lərin arxitektur məhdudiyyətlərindən qaynaqlanır. LLM-lər hər tokenin bütün kontekst boyunca hər digər tokenə diqqət yetirməsinə imkan verən transformer arxitekturasına əsaslanır. Bu, n token üçün n² cüt əlaqə ilə nəticələnir.

Kontekst uzunluğu artdıqca, modelin bu cüt əlaqələri tutma qabiliyyəti zəifləyir və kontekst ölçüsü ilə diqqət fokuslanması arasında təbii gərginlik yaranır. Bundan əlavə, modellər diqqət nümunələrini qısa ardıcıllıqların adətən uzun olanlardan daha çox rast gəlindiyi təlim məlumat paylanmalarından inkişaf etdirirlər. Bu o deməkdir ki, modellərin kontekst boyu asılılıqlar üçün daha az təcrübəsi və daha az ixtisaslaşmış parametrləri var.

Mövqe kodlaması interpolyasiyası kimi texnikalar modellərə daha uzun ardıcıllıqları əvvəlcədən təlim keçirilmiş daha kiçik kontekstə uyğunlaşdıraraq idarə etməyə imkan verir, baxmayaraq ki, token mövqeyinin anlaşılmasında müəyyən deqradasiya baş verir. Bu amillər sərt uçurum deyil, performans gradienti yaradır: modellər daha uzun kontekstlərdə yüksək qabiliyyətli qalırlar, lakin daha qısa kontekstlərdəki performanslarına nisbətən informasiya axtarışı və uzun məsafəli mühakimə üçün azalmış dəqiqlik göstərə bilərlər.

Bu reallıqlar güclü agentlər qurmaq üçün düşünülmüş kontekst mühəndisliyinin vacib olduğunu göstərir.

Effektiv kontekstin anatomiyası

LLM-lərin sonlu diqqət büdcəsi ilə məhdudlaşdığını nəzərə alsaq, yaxşı kontekst mühəndisliyi arzu olunan nəticənin ehtimalını maksimuma çatdıran ən kiçik mümkün yüksək siqnallı token dəstini tapmaq deməkdir. Bu praktikanı tətbiq etmək deyilməsi qədər asan deyil, lakin aşağıdakı bölmədə bu yol göstərici prinsipin kontekstin müxtəlif komponentləri üzrə praktikada nə demək olduğunu izah edirik.

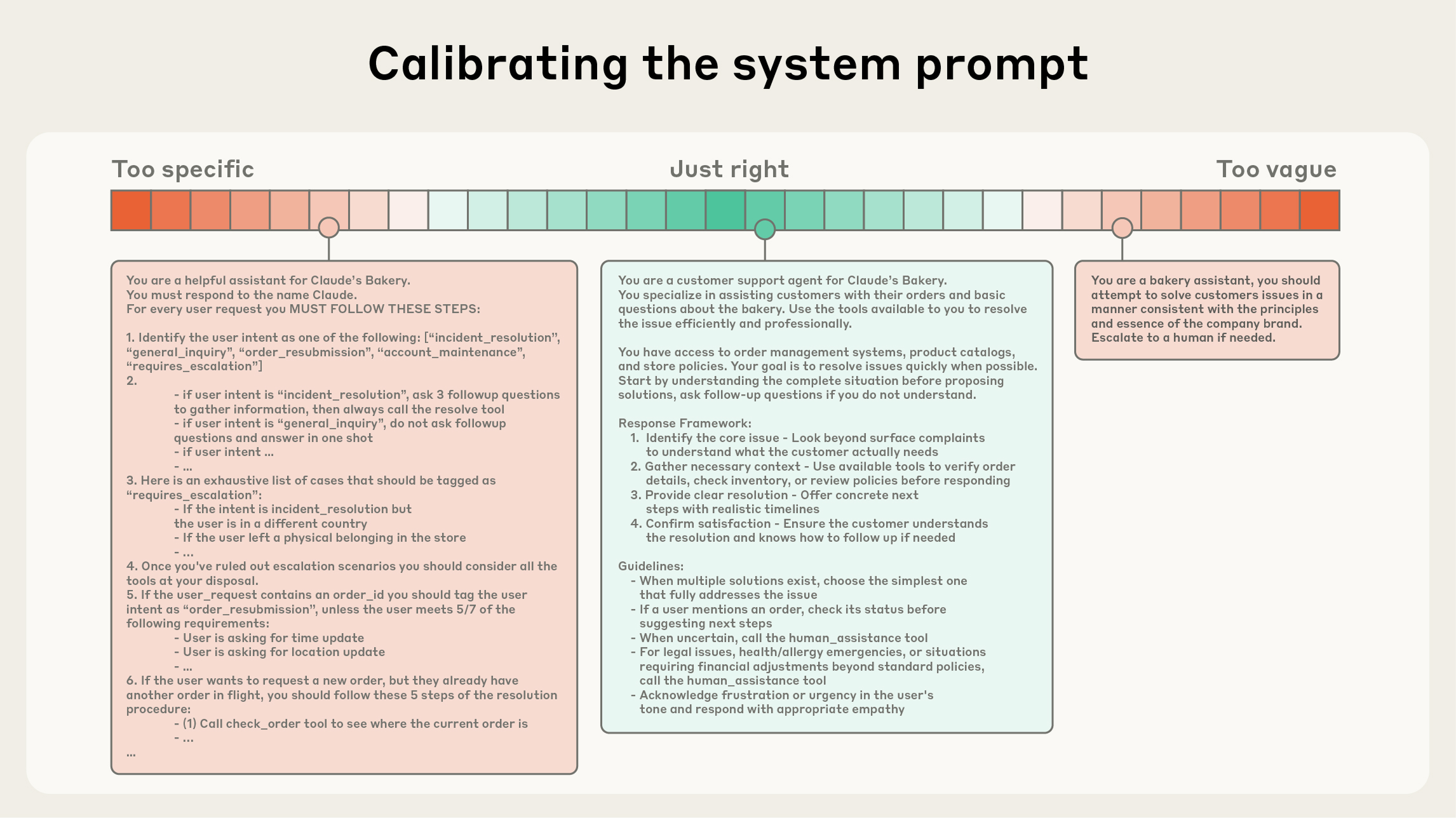

Sistem promptları son dərəcə aydın olmalı və agent üçün düzgün yüksəklikdə fikirləri təqdim edən sadə, birbaşa dildən istifadə etməlidir. Düzgün yüksəklik iki ümumi uğursuzluq rejimi arasındakı Goldilocks zonasıdır. Bir ifratda, mühəndislərin dəqiq agentik davranışı əldə etmək üçün promptlarına mürəkkəb, kövrək məntiqi sərt kodladığını görürük. Bu yanaşma kövrəklik yaradır və zaman keçdikcə texniki xidmət mürəkkəbliyini artırır. Digər ifratda isə mühəndislər bəzən LLM-ə arzu olunan nəticələr üçün konkret siqnallar verməyən və ya ortaq konteksti yanlış fərz edən qeyri-müəyyən, yüksək səviyyəli rəhbərlik təmin edirlər. Optimal yüksəklik tarazlıq yaradır: davranışı effektiv istiqamətləndirmək üçün kifayət qədər spesifik, eyni zamanda modelə davranışı istiqamətləndirmək üçün güclü evristikalar təmin edəcək qədər çevik.

Spektrin bir ucunda kövrək if-else sərt kodlanmış promptlar görürük, digər ucunda isə həddən artıq ümumi olan və ya ortaq konteksti yanlış fərz edən promptlar görürük.

Spektrin bir ucunda kövrək if-else sərt kodlanmış promptlar görürük, digər ucunda isə həddən artıq ümumi olan və ya ortaq konteksti yanlış fərz edən promptlar görürük.

Promptları fərqli bölmələrə (<background_information>, <instructions>, ## Tool guidance, ## Output description və s. kimi) təşkil etməyi və bu bölmələri ayırmaq üçün XML etiketləmə və ya Markdown başlıqları kimi texnikalardan istifadə etməyi tövsiyə edirik, baxmayaraq ki, modellər daha güclü olduqca promptların dəqiq formatlaşdırılması ehtimal ki, daha az əhəmiyyətli olur.

Sistem promptunuzu necə strukturlaşdırmağa qərar verməyinizdən asılı olmayaraq, gözlənilən davranışınızı tam əhatə edən minimal informasiya dəstini əldə etməyə çalışmalısınız. (Qeyd edin ki, minimal mütləq qısa demək deyil; agentin arzu olunan davranışa riayət etməsini təmin etmək üçün ona əvvəlcədən kifayət qədər məlumat verməlisiniz.) Ən yaxşısı əvvəlcə mövcud olan ən yaxşı modellə minimal promptu sınaqdan keçirmək, sonra ilkin sınaq zamanı tapılan uğursuzluq rejimlərinə əsasən performansı yaxşılaşdırmaq üçün aydın təlimatlar və nümunələr əlavə etməkdir.

Alətlər agentlərə öz mühitləri ilə əlaqə qurmağa və işlədikləri zaman yeni, əlavə kontekst çəkməyə imkan verir. Alətlər agentlər və onların informasiya/fəaliyyət sahəsi arasındakı müqaviləni müəyyən etdiyi üçün, alətlərin səmərəliliyi təşviq etməsi son dərəcə vacibdir — həm token baxımından səmərəli informasiya qaytarmaqla, həm də səmərəli agent davranışlarını təşviq etməklə.

Süni intellekt agentləri üçün alətlər yazmaq – süni intellekt agentləri ilə məqaləsində LLM-lər tərəfindən yaxşı başa düşülən və funksionallıqda minimal örtüşmə olan alətlər qurmağı müzakirə etdik. Yaxşı dizayn edilmiş kod bazasının funksiyaları kimi, alətlər müstəqil, xətalara davamlı və nəzərdə tutulan istifadələri baxımından son dərəcə aydın olmalıdır. Giriş parametrləri də eyni şəkildə təsviri, birmənalı və modelin xas güclü tərəflərindən istifadə edən olmalıdır.

Gördüyümüz ən çox rast gəlinən uğursuzluq rejimlərindən biri həddən artıq çox funksionallığı əhatə edən və ya hansı alətin istifadə edilməsi barədə qeyri-müəyyən qərar nöqtələrinə gətirib çıxaran şişirdilmiş alət dəstləridir. Əgər insan mühəndis müəyyən bir vəziyyətdə hansı alətin istifadə edilməli olduğunu qəti şəkildə deyə bilmirsə, süni intellekt agentinin daha yaxşısını etməsi gözlənilə bilməz. Sonra müzakirə edəcəyimiz kimi, agent üçün minimal həyat qabiliyyətli alət dəstinin seçilməsi uzun əlaqələr zamanı kontekstin daha etibarlı saxlanmasına və təmizlənməsinə gətirib çıxara bilər.

Nümunələr təqdim etmək, başqa sözlə few-shot prompting, yaxşı tanınan bir ən yaxşı təcrübədir ki, onu möhkəm şəkildə tövsiyə etməyə davam edirik. Lakin komandalar çox vaxt LLM-in müəyyən bir tapşırıq üçün əməl etməli olduğu hər mümkün qaydanı ifadə etmək cəhdi ilə prompta kənar halların uzun siyahısını doldururlar. Biz bunu tövsiyə etmirik. Əvəzinə, agentin gözlənilən davranışını effektiv şəkildə əks etdirən müxtəlif, kanonik nümunələr dəsti hazırlamağı tövsiyə edirik. LLM üçün nümunələr min sözə bərabər olan "şəkillərdir".

Kontekstin müxtəlif komponentləri (sistem promptları, alətlər, nümunələr, mesaj tarixçəsi və s.) üzrə ümumi tövsiyəmiz düşüncəli olmaq və kontekstinizi informativ, lakin yığcam saxlamaqdır. İndi isə icra zamanı kontekstin dinamik əldə edilməsinə keçək.

Kontekst əldə etmə və agentik axtarış

Effektiv süni intellekt agentləri qurmaq məqaləsində LLM əsaslı iş axınları ilə agentlər arasındakı fərqləri vurğuladıq. Həmin yazını yazdığımızdan bəri, agentlər üçün sadə bir tərifə meyl etdik: döngüdə müstəqil şəkildə alətlərdən istifadə edən LLM-lər.

Müştərilərimizlə birlikdə işləyərkən, sahənin bu sadə paradiqmada birləşdiyini gördük. Əsas modellər daha güclü olduqca, agentlərin muxtariyyət səviyyəsi artırıla bilər: daha ağıllı modellər agentlərə nüanslı problem sahələrini müstəqil şəkildə idarə etməyə və xətalardan bərpa olmağa imkan verir.

İndi mühəndislərin agentlər üçün kontekst dizaynı haqqında düşünmə tərzində dəyişiklik müşahidə edirik. Bu gün bir çox süni intellektə əsaslanan tətbiqlər agentin mühakimə aparması üçün vacib konteksti üzə çıxarmaq üçün embedding əsaslı inferensiyadan əvvəl əldə etmənin müəyyən formasını tətbiq edir. Sahə daha agentik yanaşmalara keçdikcə, komandaların bu əldə etmə sistemlərini "tam vaxtında" kontekst strategiyaları ilə gücləndirdiyini getdikcə daha çox görürük.

Bütün əlaqəli məlumatları əvvəlcədən emal etmək əvəzinə, "tam vaxtında" yanaşması ilə qurulan agentlər yüngül identifikatorlar (fayl yolları, saxlanmış sorğular, veb keçidlər və s.) saxlayır və bu istinadlardan istifadə edərək alətlər vasitəsilə icra zamanı dinamik şəkildə məlumatları kontekstə yükləyirlər. Anthropic-in agentik kodlaşdırma həlli olan Claude Code böyük verilənlər bazaları üzərində mürəkkəb məlumat analizi aparmaq üçün bu yanaşmadan istifadə edir. Model tam məlumat obyektlərini heç vaxt kontekstə yükləmədən hədəflənmiş sorğular yaza, nəticələri saxlaya və böyük həcmli məlumatları analiz etmək üçün head və tail kimi Bash əmrlərindən istifadə edə bilər. Bu yanaşma insan idrakını əks etdirir: biz ümumiyyətlə bütün informasiya korpuslarını əzbərləmirik, əksinə tələb üzrə əlaqəli informasiyanı əldə etmək üçün fayl sistemləri, gələnlər qutuları və əlfəcinlər kimi xarici təşkilat və indeksləmə sistemləri təqdim edirik.

Saxlama səmərəliliyindən əlavə, bu istinadların metadatası davranışı səmərəli təkmilləşdirmək üçün mexanizm təmin edir — istər açıq şəkildə verilmiş, istərsə də intuitiv olsun. Fayl sistemində işləyən agent üçün tests qovluğundakı test_utils.py adlı faylın mövcudluğu src/core_logic/-da eyni adlı fayldan fərqli məqsəd ifadə edir. Qovluq iyerarxiyaları, adlandırma konvensiyaları və zaman damğaları həm insanlara, həm də agentlərə informasiyanı necə və nə vaxt istifadə edəcəklərini anlamağa kömək edən vacib siqnallar təmin edir.

Agentlərə məlumatları müstəqil şəkildə naviqasiya etməyə və əldə etməyə imkan vermək həmçinin tədricən açıqlamanı — başqa sözlə, agentlərə kəşf yolu ilə əlaqəli konteksti addım-addım aşkar etməyə imkan verir. Hər qarşılıqlı əlaqə növbəti qərarı məlumatlandıran kontekst yaradır: fayl ölçüləri mürəkkəbliyi göstərir; adlandırma konvensiyaları məqsədə işarə edir; zaman damğaları aktuallıq üçün vəkil ola bilər. Agentlər anlayışı qat-qat toplaya, işçi yaddaşda yalnız lazım olanı saxlaya və əlavə davamlılıq üçün qeyd aparma strategiyalarından istifadə edə bilərlər. Bu öz-özünə idarə olunan kontekst pəncərəsi agenti hərtərəfli, lakin potensial olaraq əlaqəsiz informasiyada boğulmaq əvəzinə əlaqəli alt çoxluqlara fokuslanmış saxlayır.

Əlbəttə, burada kompromis var: icra zamanı kəşf əvvəlcədən hesablanmış məlumatların əldə edilməsindən daha yavaşdır. Təkcə bu deyil, həm də LLM-in öz informasiya landşaftını effektiv naviqasiya etməsi üçün düzgün alətlərə və evristikalara sahib olmasını təmin etmək üçün qərəzli və düşüncəli mühəndislik tələb olunur. Düzgün istiqamətləndirmə olmadan, agent alətlərdən sui-istifadə edərək, çıxılmaz yollara düşərək və ya əsas informasiyanı müəyyən edə bilməyərək konteksti israf edə bilər.

Müəyyən şəraitlərdə ən effektiv agentlər hibrid strategiya tətbiq edə bilər — sürət üçün bəzi məlumatları əvvəlcədən əldə etmək və öz mülahizəsinə uyğun olaraq əlavə müstəqil kəşf aparmaq. "Düzgün" muxtariyyət səviyyəsinin sərhədi tapşırıqdan asılıdır. Claude Code bu hibrid modeli tətbiq edən agentdir: CLAUDE.md faylları sadəlövhcəsinə əvvəlcədən kontekstə daxil edilir, glob və grep kimi primitivlər isə ona mühitini naviqasiya etməyə və faylları tam vaxtında əldə etməyə imkan verir, köhnəlmiş indeksləmə və mürəkkəb sintaksis ağacları problemlərini effektiv şəkildə aradan qaldırır.

Hibrid strategiya hüquq və ya maliyyə işi kimi daha az dinamik məzmuna malik kontekstlər üçün daha uyğun ola bilər. Model imkanları yaxşılaşdıqca, agentik dizayn ağıllı modellərə ağıllı hərəkət etməyə icazə verməyə doğru meyl edəcək, tədricən daha az insan kurasiyası ilə. Sahədə sürətli irəliləyişi nəzərə alsaq, "işləyən ən sadə şeyi edin" ehtimal ki, Claude üzərində agentlər quran komandalar üçün ən yaxşı tövsiyəmiz olaraq qalacaq.

Uzun üfüqlü tapşırıqlar üçün kontekst mühəndisliyi

Uzun üfüqlü tapşırıqlar agentlərdən token sayının LLM-in kontekst pəncərəsini aşdığı fəaliyyət ardıcıllıqları boyunca tutarlılığı, konteksti və məqsədyönlü davranışı qorumağı tələb edir. On dəqiqədən bir neçə saata qədər davamlı işi əhatə edən tapşırıqlar üçün — böyük kod bazası miqrasiyaları və ya hərtərəfli tədqiqat layihələri kimi — agentlər kontekst pəncərəsi ölçüsü məhdudiyyətini aşmaq üçün xüsusi texnikalar tələb edirlər.

Daha böyük kontekst pəncərələri gözləmək aşkar taktika kimi görünə bilər. Lakin çox güman ki, yaxın gələcəkdə bütün ölçülərdə kontekst pəncərələri kontekst çirklənməsi və informasiya aktuallığı problemlərinə məruz qalacaq — ən azı ən güclü agent performansının tələb olunduğu vəziyyətlərdə. Agentlərin genişləndirilmiş zaman üfüqləri boyunca effektiv işləməsini təmin etmək üçün bu kontekst çirklənməsi məhdudiyyətlərini birbaşa həll edən bir neçə texnika hazırladıq: sıxlaşdırma, strukturlaşdırılmış qeyd aparma və çox-agentli arxitekturalar.

Sıxlaşdırma

Sıxlaşdırma kontekst pəncərəsi limitinə yaxınlaşan söhbəti götürmək, məzmununu ümumiləşdirmək və xülasə ilə yeni kontekst pəncərəsi başlatmaq praktikasıdır. Sıxlaşdırma adətən daha yaxşı uzunmüddətli tutarlılıq üçün kontekst mühəndisliyində ilk vasitə kimi xidmət edir. Mahiyyətcə, sıxlaşdırma kontekst pəncərəsinin məzmununu yüksək dəqiqliklə distillə edir və agentin minimal performans deqradasiyası ilə davam etməsinə imkan verir.

Claude Code-da, məsələn, biz bunu mesaj tarixçəsini modelə ötürərək ən kritik detalları ümumiləşdirmək və sıxışdırmaq üçün tətbiq edirik. Model arxitektur qərarlarını, həll olunmamış xətaları və tətbiq detallarını qoruyarkən artıq alət çıxışlarını və ya mesajları atır. Agent sonra bu sıxışdırılmış kontekst üstəgəl ən son açılmış beş fayl ilə davam edə bilər. İstifadəçilər kontekst pəncərəsi məhdudiyyətləri barədə narahat olmadan davamlılıq əldə edirlər.

Sıxlaşdırmanın sənəti nəyi saxlamaq və nəyi atmaq barəsində seçimdədir, çünki həddən artıq aqressiv sıxlaşdırma əhəmiyyəti yalnız sonradan aşkar olan incə, lakin kritik kontekstin itirilməsinə səbəb ola bilər. Sıxlaşdırma sistemləri tətbiq edən mühəndislər üçün mürəkkəb agent izləri üzərində promptunuzu diqqətlə kökləməyi tövsiyə edirik. Sıxlaşdırma promptunuzun izləmədən hər əlaqəli məlumatı tutmasını təmin etmək üçün xatırlama (recall) səviyyəsini maksimuma çatdıraraq başlayın, sonra artıq məzmunu aradan qaldıraraq dəqiqliyi (precision) yaxşılaşdırmaq üçün iterasiya edin.

Artıq məzmuna aşağı asılmış meyvə nümunəsi alət çağırışlarını və nəticələrini təmizləməkdir — alət mesaj tarixçəsinin dərinliyində çağırıldıqdan sonra, agentin xam nəticəni yenidən görməsinə niyə ehtiyac olsun? Sıxlaşdırmanın ən təhlükəsiz, ən yüngül toxunuşlu formalarından biri alət nəticələrinin təmizlənməsidir, bu yaxınlarda Claude Developer Platform-da xüsusiyyət kimi təqdim edildi.

Strukturlaşdırılmış qeyd aparma

Strukturlaşdırılmış qeyd aparma, və ya agentik yaddaş, agentin kontekst pəncərəsindən kənarda yaddaşda saxlanılan qeydləri müntəzəm olaraq yazdığı texnikadır. Bu qeydlər sonrakı vaxtlarda kontekst pəncərəsinə geri çəkilir.

Title: AI agentləri üçün effektiv kontekst mühəndisliyi (2-ci hissə)

Content:

Bu strategiya minimal yüklə davamlı yaddaş təmin edir. Claude Code-un tapşırıq siyahısı yaratması və ya sizin xüsusi agentinizin NOTES.md faylını saxlaması kimi, bu sadə pattern agentə mürəkkəb tapşırıqlar boyunca irəliləyişi izləməyə, onlarla tool çağırışı ərzində itəcək kritik kontekst və asılılıqları qorumağa imkan verir.

Claude Pokémon oynayır yaddaşın kod yazmaqdan kənar sahələrdə agent imkanlarını necə dəyişdirdiyini nümayiş etdirir. Agent minlərlə oyun addımı boyunca dəqiq hesablar aparır — "son 1,234 addımdır Route 1-də Pokémon-umu məşq etdirirəm, Pikachu hədəf olan 10-a doğru 8 səviyyə qazanıb" kimi məqsədləri izləyir. Yaddaş strukturu haqqında heç bir təlimat almadan, o, kəşf edilmiş ərazilərin xəritələrini hazırlayır, hansı əsas nailiyyətləri əldə etdiyini xatırlayır və müxtəlif rəqiblərə qarşı hansı hücumların daha yaxşı işlədiyini öyrənməyə kömək edən döyüş strategiyaları qeydlərini saxlayır.

Kontekst sıfırlanmalarından sonra agent öz qeydlərini oxuyur və çox saatlıq məşq ardıcıllıqlarını və ya gizli sərdabə kəşfiyyatlarını davam etdirir. Ümumiləşdirmə addımları arasındakı bu ardıcıllıq, bütün məlumatları yalnız LLM-in kontekst pəncərəsində saxladıqda mümkün olmayacaq uzunmüddətli strategiyaları reallaşdırır.

Sonnet 4.5 buraxılışımızın bir hissəsi olaraq, Claude Developer Platform-da fayl əsaslı sistem vasitəsilə kontekst pəncərəsindən kənarda məlumat saxlamağı və ona müraciət etməyi asanlaşdıran yaddaş aləti ictimai beta versiyasında buraxdıq. Bu, agentlərə zamanla bilik bazaları qurmağa, sessiyalar arasında layihə vəziyyətini saxlamağa və hər şeyi kontekstdə saxlamadan əvvəlki işlərə istinad etməyə imkan verir.

Alt-agent arxitekturaları

Alt-agent arxitekturaları kontekst məhdudiyyətlərini aşmağın başqa bir yolunu təqdim edir. Bir agentin bütün layihə boyunca vəziyyəti saxlamağa çalışması əvəzinə, ixtisaslaşmış alt-agentlər təmiz kontekst pəncərələri ilə fokuslanmış tapşırıqları yerinə yetirə bilər. Əsas agent yüksək səviyyəli planla koordinasiya edir, alt-agentlər isə dərin texniki iş görür və ya müvafiq məlumatları tapmaq üçün alətlərdən istifadə edir. Hər bir alt-agent on minlərlə token və ya daha çoxunu istifadə edərək geniş araşdırma apara bilər, lakin yalnız öz işinin qısa, damıdılmış xülasəsini (adətən 1,000-2,000 token) qaytarır.

Bu yanaşma aydın vəzifələr bölgüsü təmin edir — ətraflı axtarış konteksti alt-agentlər daxilində təcrid olunmuş qalır, aparıcı agent isə nəticələri sintez etməyə və təhlil etməyə fokuslanır. Çoxagentli tədqiqat sistemimizi necə qurduq məqaləsində müzakirə olunan bu pattern, mürəkkəb tədqiqat tapşırıqlarında tək agentli sistemlərə nisbətən əhəmiyyətli təkmilləşdirmə göstərdi.

Bu yanaşmalar arasında seçim tapşırığın xüsusiyyətlərindən asılıdır. Məsələn:

- Sıxlaşdırma geniş qarşılıqlı əlaqə tələb edən tapşırıqlar üçün söhbət axınını qoruyur;

- Qeyd tutma aydın mərhələləri olan iterativ inkişaf üçün əladır;

- Çoxagentli arxitekturalar paralel kəşfiyyatın fayda verdiyi mürəkkəb tədqiqat və təhlil işlərini həll edir.

Modellər təkmilləşməyə davam etsə belə, uzun müddətli qarşılıqlı əlaqələr boyunca ardıcıllığı qorumaq problemi daha effektiv agentlər qurmağın mərkəzində qalmağa davam edəcək.

Nəticə

Kontekst mühəndisliyi LLM-lərlə necə qurduğumuza dair fundamental bir dəyişikliyi təmsil edir. Modellər daha bacarıqlı olduqca, problem yalnız mükəmməl prompt hazırlamaq deyil — hər addımda modelin məhdud diqqət büdcəsinə hansı məlumatın daxil olacağını düşünülmüş şəkildə kurasiya etməkdir. İstər uzunmüddətli tapşırıqlar üçün sıxlaşdırma tətbiq edin, istər token-effektiv alətlər dizayn edin, istərsə də agentlərə öz mühitlərini tam lazım olan anda kəşf etməyə imkan verin, əsas prinsip eyni qalır: istədiyiniz nəticənin ehtimalını maksimuma çatdıran ən kiçik yüksək siqnallı token dəstini tapın.

Təsvir etdiyimiz texnikalar modellər təkmilləşdikcə inkişaf etməyə davam edəcək. Artıq görürük ki, daha ağıllı modellər daha az preskriptiv mühəndislik tələb edir və agentlərin daha çox avtonomiya ilə işləməsinə imkan verir. Lakin imkanlar miqyaslandıqca belə, kontekstə qiymətli, məhdud resurs kimi yanaşmaq etibarlı, effektiv agentlər qurmağın mərkəzində qalacaq.

Claude Developer Platform-da bu gün kontekst mühəndisliyinə başlayın və yaddaş və kontekst idarəetməsi cookbook-umuz vasitəsilə faydalı məsləhətlərə və ən yaxşı təcrübələrə daxil olun.

Təşəkkürlər

Anthropic-in Applied AI komandası tərəfindən yazılmışdır: Prithvi Rajasekaran, Ethan Dixon, Carly Ryan və Jeremy Hadfield, komanda üzvləri Rafi Ayub, Hannah Moran, Cal Rueb və Connor Jennings-in töhfələri ilə. Molly Vorwerck, Stuart Ritchie və Maggie Vo-ya dəstəklərinə görə xüsusi təşəkkür.